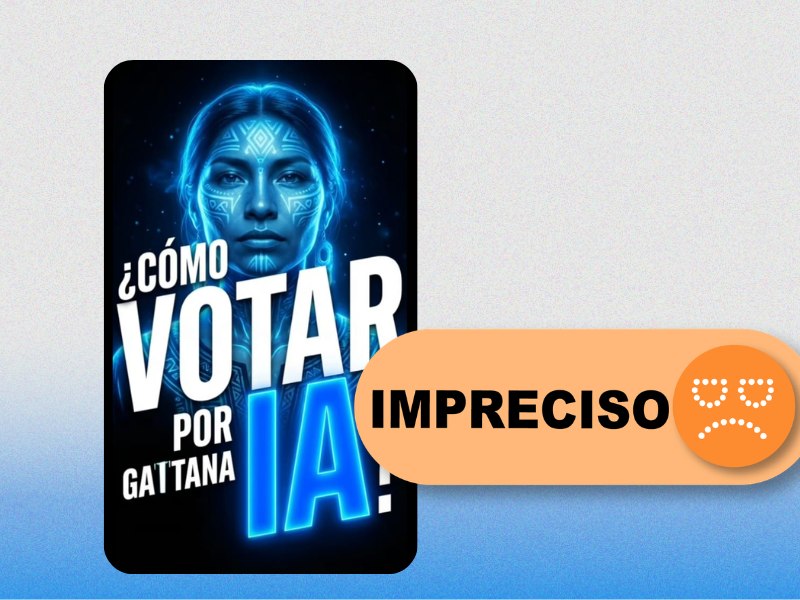

Es cierto que el INSPI difundió una imagen alterada en su rendición de cuentas en Cuenca

El Instituto Nacional de Investigación en Salud Pública (INSPI) difundió una fotografía alterada para aparentar un auditorio lleno durante su rendición de cuentas en Azuay. La evidencia visual, la transmisión oficial del evento y análisis con herramientas de detección respaldan que la imagen no corresponde a la asistencia real.