Videos virales no corresponden a galletas danesas exportadas desde India

Si recibes un mensaje similar, recuerda que puedes enviárnoslo por WhatsApp al (+593 96 239 6425) y te ayudaremos a verificarlo de manera directa y sencilla.

¿Qué verificamos?

Un video viral que circula en TikTok, Instagram y YouTube desde noviembre de 2025. Muestra supuestas condiciones insalubres en la producción de alimentos y ha sido presentado como evidencia de que las galletas danesas importadas serían inseguras, lo que llevó a llamados en redes a no consumirlas.

¿Por qué es mayormente falso?

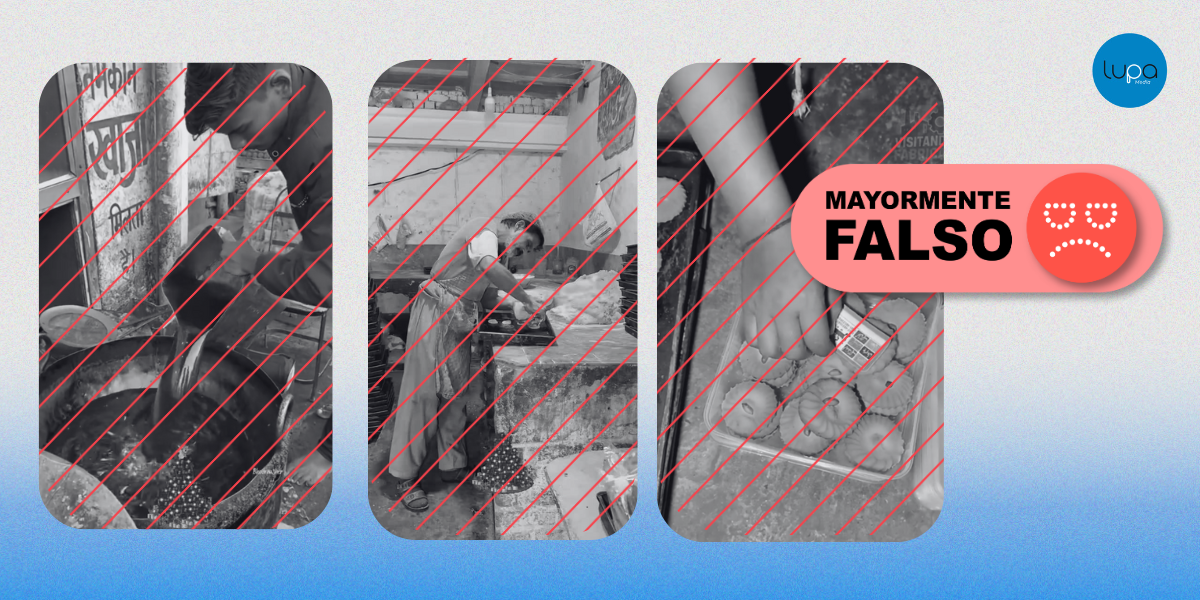

Porque el video mezcla clips de distintas producciones de alimentos en India que no tienen relación con galletas danesas de exportación. Entre ellos hay contenido satírico, elaboración de azúcar bhoora, comida callejera y galletas locales. Además, no existen reportes oficiales de contaminación en galletas importadas elaboradas por fábricas certificadas.

¿Qué dice la evidencia?

Una búsqueda inversa de imágenes confirmó que el video viral, difundido desde noviembre de 2025, compila clips de distintas fuentes en India sin relación entre sí.

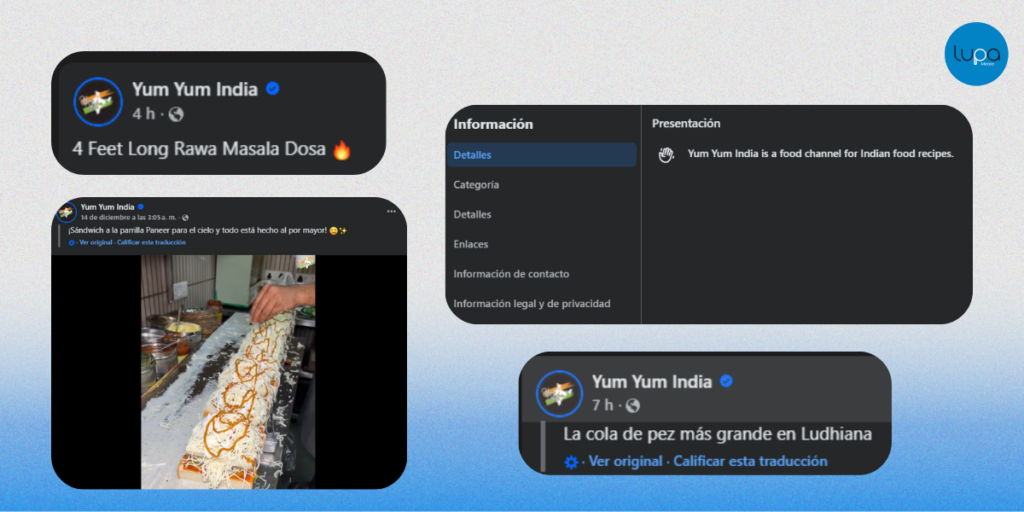

- Primer clip.- contenido satírico: Corresponde al canal Yum Yum India, conocido por videos humorísticos exagerados sobre producción de alimentos. No muestra procesos reales de fabricación ni está vinculado a galletas importadas. Este video también ha sido desmentido por la verificadora brasileña Boatos.

- Segundo clip.- roducción de azúcar bhoora: Proviene del canal Planeta Shish y fue publicado el 12 de abril de 2024. Muestra la elaboración de azúcar bhoora, un producto tradicional indio sin relación con galletas danesas.

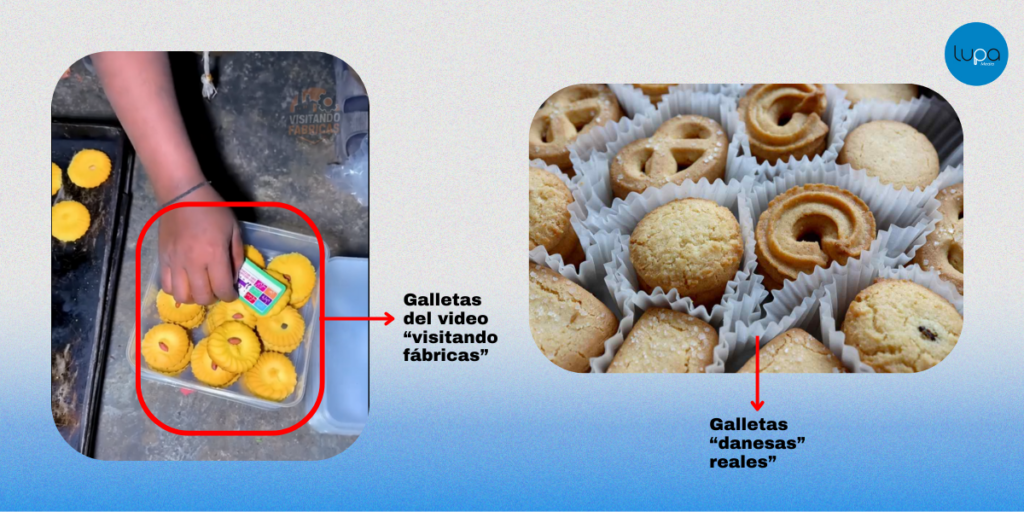

- Tercer clip.- galletas locales: Circula desde octubre de 2025 en TikTok y muestra la elaboración de galletas artesanales para consumo local, distintas a las galletas danesas enlatadas. El propio video las identifica como “galletas doradas de la India” y se empacan en un contenedor de plástico tipo topper.

- Cuarto clip.- comida callejera: Tiene la marca de agua del canal Bhookha Sher, dedicado a documentar street food en India. No corresponde a fábricas ni a producción industrial para exportación.

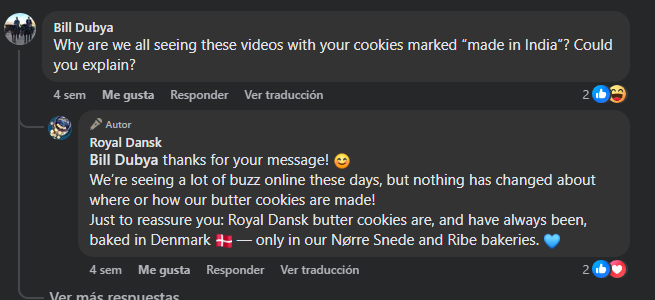

- Respuesta de la industria: Fabricantes y distribuidores publicaron videos mostrando procesos reales en plantas automatizadas y reguladas. Algunas marcas latinoamericanas que importan insumos desde India también aclararon el origen y los controles sanitarios de sus productos.

- Estándares de exportación: Las fábricas exportadoras en India, como Ravi Foods o Dukes, usan maquinaria automatizada con mínimo contacto humano y cumplen estándares internacionales como ISO, HACCP y FDA para envíos a Europa y América. Empresas como Productos Líder publicaron tours reales de sus proveedores indios, mostrando higiene estricta y contradiciendo los virales.

- No existen reportes oficiales de retiros o contaminaciones en productos como los vendidos en supermercados ecuatorianos.

Contexto importante

India enfrenta desafíos en higiene alimentaria, especialmente en el sector informal y en la comida callejera. Sin embargo, las fábricas que producen alimentos para exportación operan bajo regulaciones y certificaciones internacionales. Estos dos sistemas conviven, pero no son equivalentes ni intercambiables.

En 2013, India lideró listas negativas como el top 1 en errores de seguridad alimentaria según Food Sentry, con altos índices de contaminantes, patógenos y suciedad en inspecciones globales. En el Índice de Seguridad Alimentaria estatal (FY 2023-2024), varía por región, con estados como Kerala y Tamil Nadu superando 70/100, mientras otros como Bihar quedan por debajo de 40.

La industria procesada crece rápidamente (proyectada a 535 mil millones USD en 2025-26), impulsada por exportaciones certificadas bajo HACCP e ISO, aunque el procesamiento agrícola es bajo (10%) y persisten riesgos en mercados locales. No hay rankings unificados mundiales específicos para higiene alimentaria, pero informes como Global Hunger Index (India 105/127 en 2025) reflejan problemas relacionados con nutrición y sanidad básica.

Conclusión

MAYORMENTE FALSO: Los videos virales no muestran la producción de galletas danesas exportadas desde India. Compilan clips descontextualizados de contenido satírico, azúcar bhoora, comida callejera y galletas locales. Las fábricas que abastecen el mercado ecuatoriano operan bajo estándares internacionales y no existen reportes oficiales de problemas sanitarios en estos productos.

¿Viste algo sospechoso y quieres que lo revisemos por ti? Haz tu pedido de #VerificaciónAlaCarta a través de nuestra línea en WhatsApp (+593 96 239 6425). Recibe nuestro contenido directo en tu celular. ¡Únete a la comunidad verificadora en nuestro canal de WhatsApp!

“Ecuador se prepara para un nuevo confinamiento. En Loja la gripe H3N2 sigue avanzando y los especialistas recomiendan reforzar medidas de prevención.”

“Ecuador se prepara para un nuevo confinamiento. En Loja la gripe H3N2 sigue avanzando y los especialistas recomiendan reforzar medidas de prevención.”