Fact-Check: Daniel Noboa en Radio Centro

“Estamos viendo un crecimiento en contratación y en empleo adecuado, empleo formal sostenido de 2-3 puntos cada trimestre”

“Estamos viendo un crecimiento en contratación y en empleo adecuado, empleo formal sostenido de 2-3 puntos cada trimestre”

El empleo adecuado en 2025 pasó de 35,2% en el primer trimestre a 36,2% en el segundo y 37,2% en el tercer trimestre; es decir, aumentó un punto porcentual en cada período, según cifras del Instituto Nacional de Estadística y Censos (INEC). No obstante, en el cuarto trimestre descendió a 36,8%.

En 2024, en cambio, los porcentajes se mantuvieron alrededor del 35% e incluso el año cerró en 34,1%, sin una tendencia sostenida de crecimiento.

Aunque en 2025 se registraron incrementos cercanos a un punto porcentual en algunos trimestres, los datos no muestran alzas de entre 2 y 3 puntos por trimestre ni un crecimiento continuo, como afirmó el presidente Daniel Noboa. De hecho, en el último trimestre reportado de 2025 se produjo una reducción de 0,4 puntos porcentuales, no un aumento.

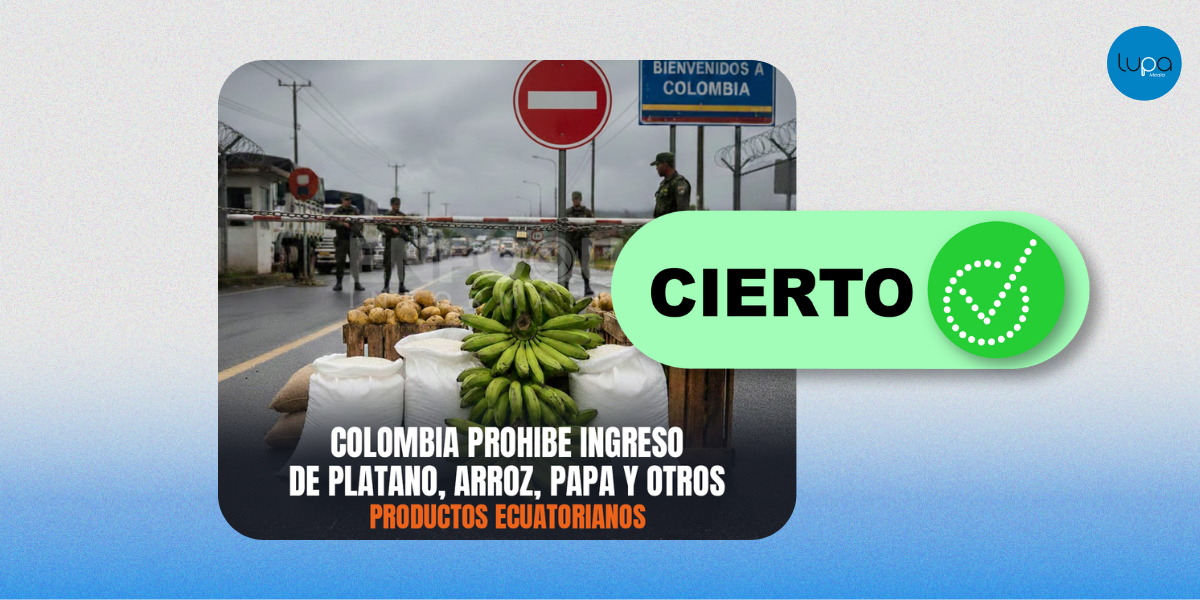

“¿Sabe cuál es nuestro peor socio comercial en el mundo?. Porcentualmente el déficit del total de los bienes comercializados es Colombia. USD 1.100 millones de déficit comercial”.

“¿Sabe cuál es nuestro peor socio comercial en el mundo?. Porcentualmente el déficit del total de los bienes comercializados es Colombia. USD 1.100 millones de déficit comercial”.

Según cifras oficiales del Banco Central del Ecuador (BCE) para 2025, las exportaciones ecuatorianas a Colombia sumaron USD 886 millones, mientras que las importaciones alcanzaron USD 1.908 millones. Esto arroja un déficit comercial de USD 1.022 millones.

El monto mencionado por el presidente es cercano al dato oficial, aunque superior en aproximadamente USD 78 millones.

Sin embargo, al comparar el saldo comercial con todods los socios en 2025, Colombia no registra el mayor déficit en términos absolutos. Los mayores saldos negativos corresponden a:

- China: ≈ USD 1.877 millones

- Estados Unidos: ≈ USD 1.800 millones

- Colombia: ≈ USD 1.022 millones

En términos absolutos, Colombia ocupa el tercer lugar entre los países con los que Ecuador mantiene mayor déficit comercial.

Además, la afirmación menciona que “porcentualmente” Colombia sería el peor socio comercial, pero no se especifica qué indicador proporcional se está utilizando (porcentaje del comercio total, peso relativo del déficit frente al intercambio bilateral, u otro criterio). Con los datos disponibles del BCE, Colombia tampoco lidera el mayor déficit en valores absolutos.

Por otra parte, José Hidalgo, director general de CORDES advierte que calificar a un país como “mejor” o “peor” socio comercial únicamente en función del déficit no es un criterio técnico adecuado. Un saldo negativo puede reflejar que Ecuador importa bienes que necesita, aunque no exporte en la misma proporción. En el comercio internacional es habitual mantener superávit con algunos países y déficit con otros, sin que ello implique que se trate de un “buen” o “mal” socio.

“Desde la tasa de seguridad las muertes violentas en las provincias fronterizas Carchi, Esmeraldas y Sucumbíos se ha reducido en 33.3%. Se lo ve febrero a febrero”

“Desde la tasa de seguridad las muertes violentas en las provincias fronterizas Carchi, Esmeraldas y Sucumbíos se ha reducido en 33.3%. Se lo ve febrero a febrero”

De acuerdo con cifras preliminares del Ministerio del Interior, entre el 1 y el 25 de febrero de 2025 se registraron 42 muertes violentas en Carchi, Esmeraldas y Sucumbíos. En el mismo periodo de 2026 se contabilizaron 28 casos. La diferencia equivale a una reducción del 33,3 %.

Sin embargo, se trata de datos aún no consolidados oficialmente y la comparación corresponde a un corte parcial (hasta el 25 de febrero en ambos años), no a meses completos. Por tanto, la variación se calcula sobre un periodo incompleto.

Con cifras oficiales consolidadas de enero, en 2025 se reportaron 47 muertes violentas en estas tres provincias, mientras que en enero de 2026 fueron 30, lo que representa una disminución del 36 %. Es decir, la reducción ya se observaba antes del periodo en el que comenzó a aplicarse la tasa de seguridad.

Si bien los datos muestran una baja en el número de muertes violentas en la comparación interanual, no existe evidencia pública que permita atribuir esa variación directamente a la implementación de la tasa. La afirmación combina un dato estadístico correcto en términos porcentuales con una atribución temporal y causal que no puede demostrarse con la información disponible.

Sobre la Ley de Minería: “se prohíbe que exista cualquier tipo de actividad minera en el Parque Nacional Galápagos que ocupa el 97% del territorio, en el 3% restante del territorio que no es Parque Nacional Galápagos se autoriza solo el retiro del material pétreo”

Sobre la Ley de Minería: “se prohíbe que exista cualquier tipo de actividad minera en el Parque Nacional Galápagos que ocupa el 97% del territorio, en el 3% restante del territorio que no es Parque Nacional Galápagos se autoriza solo el retiro del material pétreo”

El Parque Nacional Galápagos abarca aproximadamente el 97% de la superficie terrestre del archipiélago, condición vigente desde su declaratoria como área protegida. En esa zona, la normativa ambiental y el régimen especial de conservación prohíben actividades extractivas como la minería.

La reforma a la Ley de Minería establece que, en la provincia de Galápagos, únicamente podrán otorgarse permisos de libre aprovechamiento y autorizaciones para la extracción de áridos y pétreos destinados a la construcción. Estas actividades deben realizarse fuera del área del Parque Nacional y exclusivamente en Zonas de Aprovechamiento Sustentable (ZAS), conforme al régimen especial del archipiélago.

La reforma no utiliza de manera expresa la palabra “prohibición” respecto a otras formas de minería en el territorio provincial. Sin embargo, al limitar los permisos posibles a la extracción de áridos y pétreos en zonas específicas fuera del Parque Nacional, no habilita otros tipos de actividad minera en Galápagos.

“Todas las víctimas de abuso infantil terminan con trastornos mentales”

“Todas las víctimas de abuso infantil terminan con trastornos mentales”