Es falso el audio que atribuye a Daniel Noboa amenazas contra alias “Pipo”

Si recibes un mensaje similar, recuerda que puedes enviárnoslo a nuestro WhatsApp (+593 96 239 6425) y te ayudamos a verificarlo de manera directa y sencilla.

¿Qué verificamos?

Un audio viral en el que se escucha una voz atribuida al presidente Daniel Noboa insultar a alias “Pipo”, referirse al asesinato de Fernando Villavicencio y ordenar supuestas gestiones en España para silenciarlo antes de una extradición.

¿Por qué es completamente falso?

No existe evidencia documental, audiovisual ni testimonial que confirme que el presidente haya emitido esas declaraciones. El análisis técnico del archivo lo identifica como audio generado mediante inteligencia artificial.

¿Qué dice la evidencia?

Inconsistencias narrativas:

- El audio menciona acercamiento con Mariano Rajoy para realizar gestiones vinculadas al caso. Rajoy dejó de ser presidente del Gobierno de España en 2018 y no ejerce funciones públicas desde entonces.

- El audio menciona represalias contra Diario Expreso por la difusión de declaraciones de alias “Pipo”. Sin embargo, la publicación inicial de esas declaraciones fue realizada por la Agencia EFE.

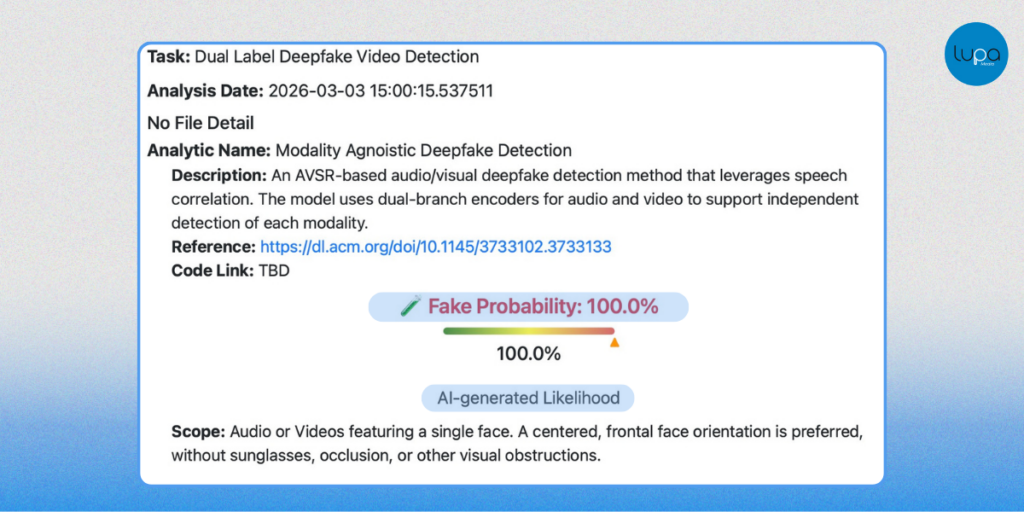

El archivo fue clasificado como audio sintético:

- DeepFake-o-meter lo clasificó como generado con inteligencia artificial con una probabilidad del 100%.

- Resemble AI lo identificó como contenido sintético según su modelo de análisis.

- Sensity lo marcó como “sospechoso” por patrones atípicos en la modulación y estructura vocal.

- Estas herramientas no sustituyen un peritaje forense independiente, pero coinciden en identificar el archivo como contenido generado artificialmente.

Inconsistencias técnicas en el audio:

Una revisión del archivo identifica patrones que suelen observarse en contenidos generados mediante síntesis de voz:

- Tonalidad uniforme: La voz mantiene una cadencia y un timbre prácticamente constantes durante todo el mensaje, sin variaciones emocionales marcadas.

- Pausas abruptas: Se registran silencios breves entre frases que no siguen un ritmo natural de conversación continua.

- Ausencia de respiraciones audibles: No se perciben inhalaciones o variaciones fisiológicas típicas del habla espontánea.

- Interferencias constantes: El audio incluye un ruido de fondo similar a interferencia telefónica que se mantiene de forma homogénea, sin fluctuaciones propias de una llamada real.

No existe respaldo verificable

- No hay registro documental, audiovisual ni institucional que confirme que el presidente haya emitido las declaraciones atribuidas.

- No existen comunicados oficiales que respalden su autenticidad.

- Ningún medio nacional o internacional con estándares editoriales ha publicado el audio como una declaración real.

- No hay constancia de investigaciones o procesos judiciales derivados de esas supuestas amenazas.

Contexto importante

La circulación del audio ocurre después de que la Agencia EFE reportara que Wilmer Chavarría, alias “Pipo”, detenido en España y señalado como líder del grupo criminal Los Lobos, declaró ante la Fiscalía de Zaragoza que el presidente Daniel Noboa estaría detrás del asesinato de Fernando Villavicencio en 2023.

Según ese reporte, Chavarría negó su participación en el crimen y afirmó que una persona cercana al ministro del Interior le habría dicho que el asesinato fue ordenado por el presidente.

No se han presentado pruebas públicas que respalden esas acusaciones. El Gobierno ecuatoriano rechazó esas declaraciones y las calificó de infundadas.

Conclusión

COMPLETAMENTE FALSO: El audio atribuido al presidente Daniel Noboa presenta inconsistencias narrativas verificables, no cuenta con respaldo documental, institucional ni periodístico que confirme su autenticidad y fue clasificado por tres sistemas de detección como contenido sintético, además de mostrar patrones acústicos frecuentes en audios generados o manipulados digitalmente.

¿Viste algo sospechoso y quieres que lo revisemos por ti? Haz tu pedido de #VerificaciónAlaCarta a través de nuestra línea en WhatsApp (+593 96 239 6425) Recibe nuestro contenido directo en tu celular. ¡Únete a la comunidad verificadora en nuestro canal de WhatsApp!

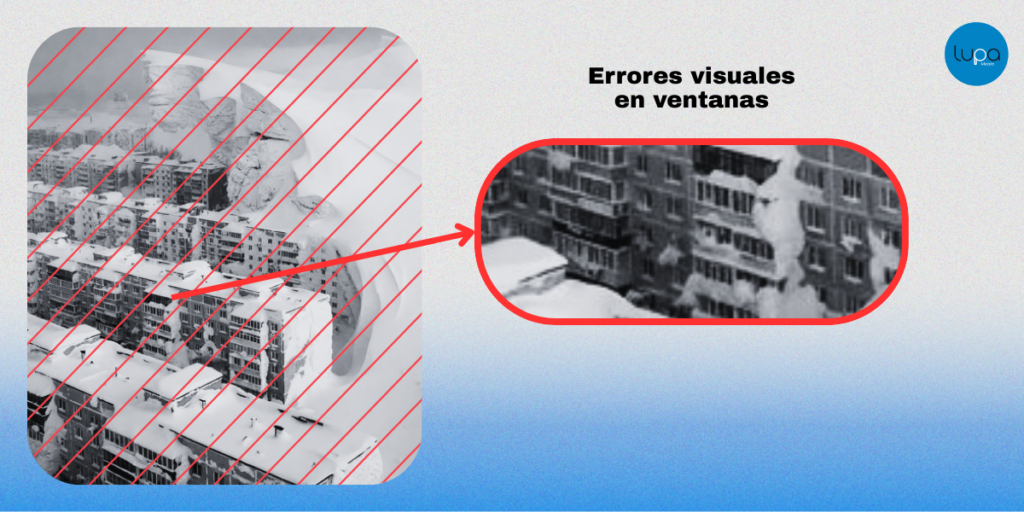

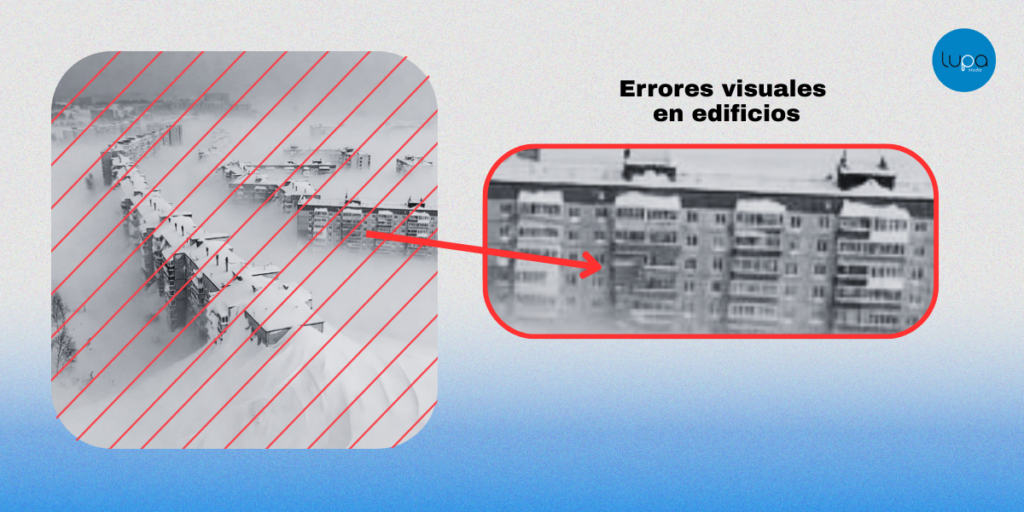

“Fotografías y video dron de Kamchatka, Rusia”

“Fotografías y video dron de Kamchatka, Rusia”

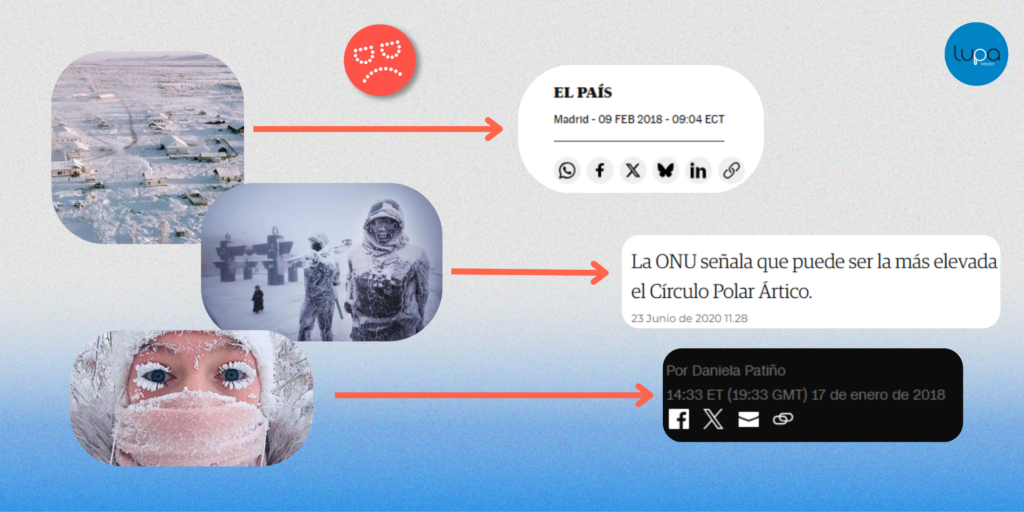

“Fotografías sobre las nevadas en Rusia que muestra a personas cubiertas por nieve incluyendo cara y ropa”

“Fotografías sobre las nevadas en Rusia que muestra a personas cubiertas por nieve incluyendo cara y ropa”

“Autos enterrados bajo la nieve”

“Autos enterrados bajo la nieve”