Desinformación a la carta: así se manipuló la campaña electoral en Ecuador

Descarga nuestro informe detallado aquí

Desinformación con estrategia y objetivos claros

Durante la campaña electoral, verificamos 247 contenidos virales. El 74% resultó ser falso. Las narrativas más recurrentes apuntaron a los dos principales candidatos: Daniel Noboa y Luisa González, quienes concentraron el 38% y el 34% del contenido desinformativo respectivamente. También se detectaron ataques al Consejo Nacional Electoral y al proceso electoral en sí.

Uno de cada cinco contenidos falsos o manipulados incluyó elementos creados con inteligencia artificial. Además, el 47,7% de las verificaciones provinieron de solicitudes ciudadanas a través del servicio #VerificaciónAlaCarta, lo que demuestra una creciente preocupación del electorado ante la circulación de información dudosa.

Narrativas diseñadas para dividir y manipular

La campaña de desinformación se articuló en torno a varios tópicos:

- Migración: Se difundieron mensajes falsos que vinculaban a personas migrantes, sobre todo venezolanas, con criminalidad, fraude electoral y beneficios económicos inexistentes. Estos contenidos apelaban al miedo y a la xenofobia, y aparecieron, en su mayoría, como publicidad pagada.

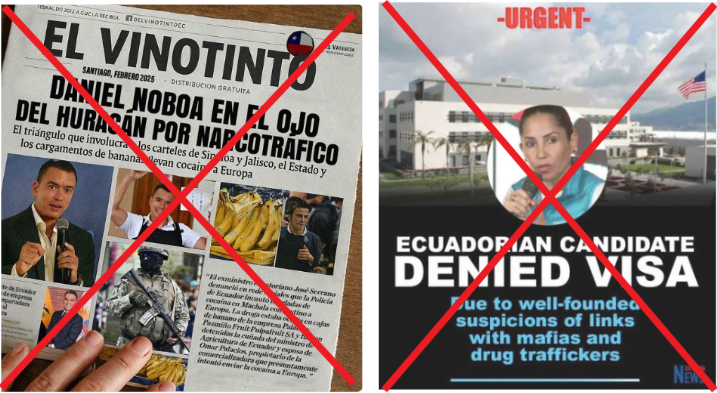

- Narcotráfico: Se intentó vincular a los candidatos con estructuras criminales mediante montajes, audios manipulados y supuestos informes sin respaldo documental. La estrategia: erosionar la credibilidad y la legitimidad de las candidaturas.

- Dolarización: Se diseminó contenido alarmista que sugería que Ecuador abandonaría el dólar si ganaba determinado candidato. En muchos casos, se usaron fragmentos de entrevistas editadas para dar la impresión de que los candidatos apoyaban la desdolarización.

- Fraude electoral: Desde antes de la jornada electoral hasta después de conocerse los resultados, se difundieron imágenes falsas de actas, videos fuera de contexto y teorías conspirativas para generar desconfianza en el sistema electoral.

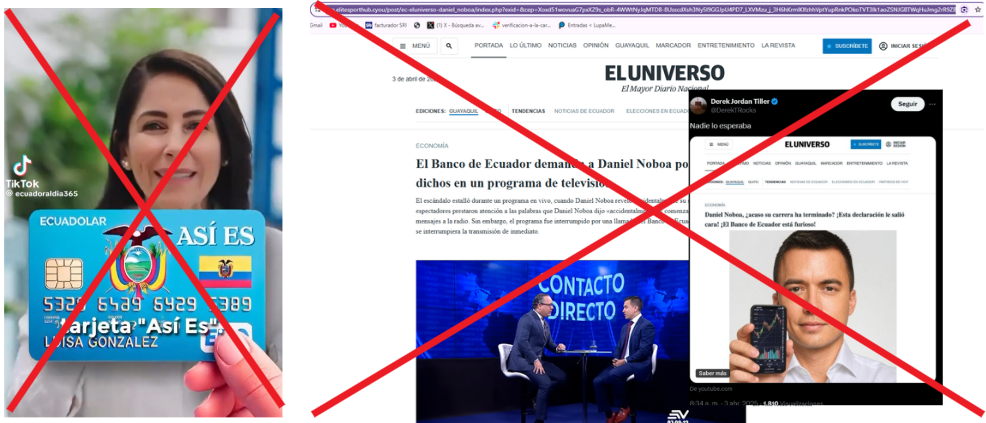

Suplantación de identidad como estrategia de manipulación

El 42% del contenido desinformativo analizado usurpó logotipos, estilos y material de medios de comunicación, instituciones públicas o figuras reconocidas para hacer pasar contenidos falsos como auténticos. Lupa Media también identificó la creación de cuentas falsas que suplantaban a medios y candidatos políticos, con el objetivo de redirigir a los usuarios a páginas fraudulentas. Estas páginas solicitaban datos personales o pagos, aprovechando temas de campaña como gancho.

Impacto visual: el poder de las imágenes y la inteligencia artificial

El 83% del contenido desinformativo circuló en formatos visuales, como imágenes y videos. Estos contenidos a menudo contenían titulares llamativos y emotivos, diseñados para captar la atención del público. Tras el debate de la segunda vuelta presidencial, Lupa Media detectó siete piezas de desinformación basadas en deepfakes, que simulaban reportes de medios internacionales como France24, RTVE, Noticias Caracol, N+Foro y Canal 24, entre otros. Las manipulaciones visuales incluían la sincronización de labios, alteración de barras informativas y la inserción de gráficas falsas.

Una de las víctimas más afectadas por esta estrategia fue Daniel Noboa, quien fue blanco de videos manipulados. También se detectaron ataques similares contra Luisa González, con declaraciones falsas atribuidas a ella. Algunos de estos videos fueron tan convincentes que incluso periodistas y figuras políticas los compartieron como reales. En total, Lupa Media desmintió cinco veces uno de estos videos debido a su viralidad.

@lupamedia 🔍 #FactCheckElectoral | 🚨 Un video manipulado con inteligencia artificial de una entrevista de Luisa González en Teleamazonas (2023) ha vuelto a circular como si fuera real. 🤨¿Lo dijo realmente? No. Luisa González nunca afirmó que se crearía una moneda paralela al dólar. Aquí te dejamos la evidencia y te explicamos todo sobre esta narrativa en nuestra verificación en lupa.com.ec (link en bio) #luisagonzalez #elecciones2025 #ecuador #dolarizacion #noticias #fyp #viral ♬ sonido original – Lupa Media

Noticieros falsos y avatares generados por inteligencia artificial

Lupa Media también identificó la creación de noticieros completamente falsos, presentados por avatares generados con inteligencia artificial para simular reportajes reales. Estas piezas de desinformación tenían un alto nivel de sofisticación, lo que dificultó su detección para muchos usuarios.

@lupamedia 🔍#FactCheckLupa | 🔴 Un contenido viral utiliza fraudulentamente la identidad del medio colombiano NTN24 para difundir información falsa sobre la participación del presidente ecuatoriano en la ceremonia de investidura del presidente Donald Trump. Te contamos la evidencia #danielnoboa #eleccionesecuador2025 #fyp #viral ♬ sonido original – Lupa Media

Plataformas digitales sin control y publicidad pagada

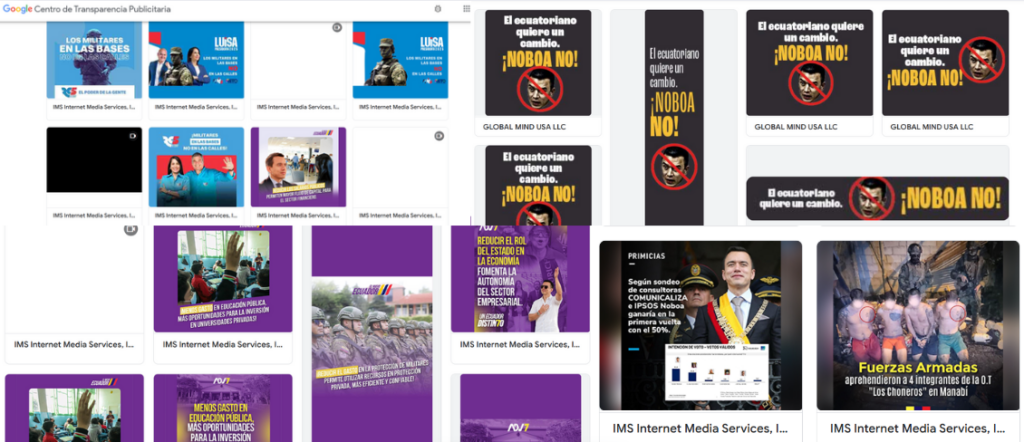

La desinformación circuló principalmente en redes sociales como X (antes Twitter), TikTok, Facebook, Instagram y WhatsApp, pero su propagación no fue aleatoria. Lupa Media identificó campañas dirigidas, muchas de ellas pagadas, que aprovecharon la escasa regulación de la publicidad digital electoral en Ecuador y el debilitamiento de las políticas de moderación de contenido de las plataformas digitales.

Se detectó la participación de al menos dos empresas extranjeras —IMS Internet Media Services y Global Mind USA LLC— que difundieron contenido desinformativo a través de productos de Google. En el caso de IMS, las campañas estuvieron dirigidas a desacreditar a Luisa González en la primera vuelta, y también al binomio Noboa-Pinto en la segunda. Global Mind, por su parte, pautó más de 300 anuncios contra Noboa. Estos contenidos combinaban datos ciertos con elementos claramente manipulados y falsos.

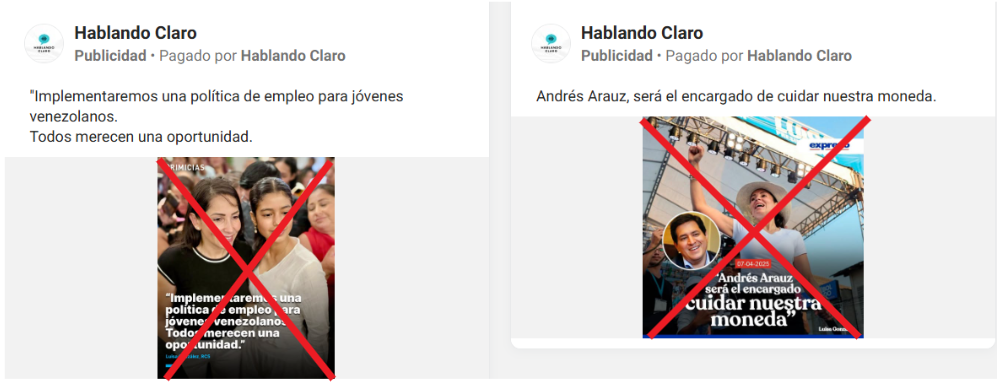

La página de Facebook “Hablando Claro”, creada en octubre de 2024, lo evidencia. Con administradores en México y Ecuador, empleó logos falsos de medios reconocidos y un lenguaje pseudo-periodístico para dar apariencia de legitimidad a contenidos abiertamente falsos. Todo su contenido promocionado fue desinformación.

Voces influyentes como amplificadores

Otro fenómeno preocupante fue la participación activa de figuras públicas y periodistas con amplio alcance en redes sociales. Estas cuentas, muchas veces asociadas a intereses políticos, compartieron contenido falso o manipulado, incluidas piezas generadas con IA. El expresidente Rafael Correa, por ejemplo, difundió varios de estos contenidos desde su cuenta de X, con más de 4 millones de seguidores, amplificando su alcance de forma masiva.

Asimismo, se identificó una red de portales web y perfiles en redes sociales que simulan ser medios de comunicación. Estos espacios adoptan los códigos visuales y narrativos del periodismo tradicional para ganar legitimidad, pero en realidad funcionan como plataformas de propaganda partidista.

67 afirmaciones bajo la lupa: ¿Qué tan precisos fueron los discursos electorales?

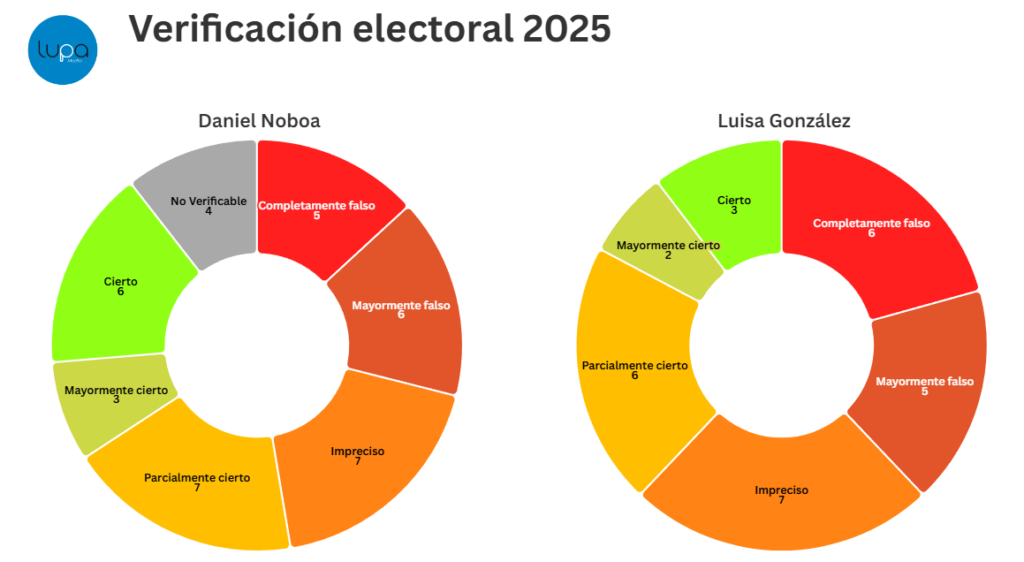

Además del monitoreo de contenido viral, Lupa Media verificó 67 afirmaciones públicas de los candidatos finalistas. Durante toda la campaña electoral, monitoreamos diariamente las entrevistas, las redes sociales oficiales de los candidatos y otros contenidos relevantes vinculados al proceso electoral. También se realizó un análisis detallado del debate presidencial.

Las frases seleccionadas para verificación contenían afirmaciones concretas sobre hechos, datos o cifras que podían ser contrastadas con fuentes oficiales, estudios académicos, reportes de organismos especializados o registros históricos. Quedaron fuera del análisis las opiniones, interpretaciones subjetivas y declaraciones sin sustento verifica

El 53,7% fue clasificado entre impreciso y falso. Mientras que el 40,3% fue considerado cierto o parcialmente cierto. En el caso del presidente-candidato Noboa, un 6% de sus afirmaciones no pudo ser verificado por falta de evidencia confiable.

Las temáticas económicas, de seguridad y energía dominaron las declaraciones verificadas de Noboa, mientras que González centró sus afirmaciones principalmente en seguridad y economía.

Una reflexión: el desafío de la IA en campañas electorales

La experiencia de la campaña de 2025 dejó en evidencia una tormenta perfecta: herramientas de inteligencia artificial sin regulación, plataformas digitales sin filtros eficaces y una ciudadanía expuesta a una sobrecarga de información muchas veces engañosa. Hoy, la verdad compite en condiciones de desventaja frente a mensajes diseñados para viralizarse.

Urge un debate serio sobre la responsabilidad de las plataformas, la transparencia de los algoritmos y la regulación del uso de la IA en procesos democráticos. De lo contrario, el juego político seguirá condicionado por campañas que no buscan informar, sino manipular.

En un contexto donde los desinformadores actúan con libertad y presupuesto, mientras los verificadores enfrentamos limitaciones y ataques, proteger el derecho a una información veraz y contrastada se convierte en una prioridad para la salud de la democracia.

Fuentes:

Lupa Media