Tu historial amoroso, médico o laboral en manos de la IA: ¿cómo proteger tu privacidad de los chatbots?

Este es un artículo original de Factchequeado. Puedes revisarlo completo aquí.

¿Qué datos recopilan los chatbots de IA?

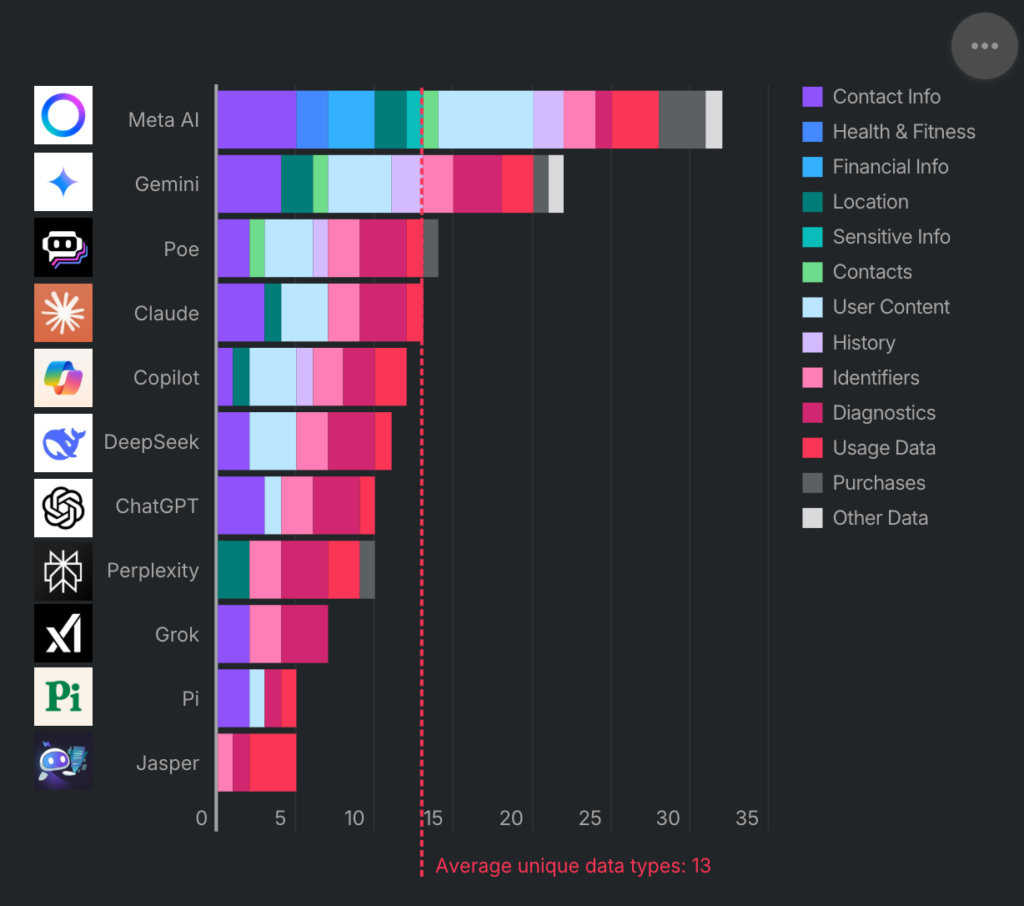

Un análisis de Surfshark sobre los chatbots más populares en la App Store reveló que todos recopilan datos de usuarios, con un promedio de 13 tipos por app. El 45 % obtiene ubicación, mientras que Meta AI recopila 32 tipos, incluyendo información sensible como salud, finanzas y datos biométricos. Copilot, Poe y Jasper usan datos para publicidad o venderlos a brokers; Perplexity recopila menos datos y permite opt-out fácil; Grok recoge unos 20 tipos, incluyendo tus publicaciones, con opt-in automático.

Un estudio de la Universidad de Stanford analizó las políticas de privacidad de 6 grandes empresas (Amazon, Anthropic, Google, Meta, Microsoft y OpenAI) y encontró riesgos relevantes:

- Uso de conversaciones para entrenar modelos de lenguaje (LLMs).

- Periodos largos de retención de datos.

- El entrenamiento con datos de menores.

- Falta de transparencia sobre cómo se manejan los datos.

Los chats de las plataformas como Google, Meta y Microsoft pueden mezclarse con información de búsquedas, compras y redes sociales. En muchos casos, el entrenamiento con chats está activado por defecto y requiere que el usuario busque la opción de exclusión (“opt‑out”)

Riesgos específicos para tu privacidad

1. Filtraciones y hackeos

Los chatbots almacenan conversaciones que pueden incluir datos sensibles —médicos, laborales, financieros o personales—, lo que los convierte en un objetivo para ciberdelincuentes. Las vulnerabilidades pueden aparecer en APIs, secuestro de sesiones o integraciones con servicios como correo, calendario o documentos en la nube.

2. Revisión humana de conversaciones

Aunque parezca que solo hablas con una máquina, algunas interacciones pueden ser revisadas por personas. Esto significa que consejos médicos, problemas en tu empleo o tu vida amorosa podrían ser leídos para mejorar los sistemas.

3. Publicidad y perfilado

Los datos compartidos con chatbots tienen valor comercial. Algunas plataformas ya exploran incluir anuncios, y estudios han encontrado que varias apps de “compañeros de IA” recopilan identificadores de dispositivo y comparten datos con terceros para publicidad dirigida.

4. Inferencias sobre tu vida

Incluso sin datos explícitos, los algoritmos pueden deducir información sobre tu salud, tu trabajo o tus relaciones personales. Por ejemplo, pedir recetas bajas en azúcar podría llevar a que el sistema infiera posibles problemas de salud, mientras que consultas sobre productividad o relaciones podrían generar anuncios adaptados a tu perfil.

Cómo proteger tu privacidad

1. Usa el chatbot sin iniciar sesión

Accede en modo privado o sin crear cuenta para limitar la información asociada a tu identidad. Esto reduce riesgos en tus consultas médicas, laborales o amorosas.

2. Ajusta la configuración de privacidad

Evita iniciar sesión con Google o Facebook, usa contraseñas fuertes y revisa los ajustes de privacidad. Desactiva historial, memoria o personalización si no los necesitas.

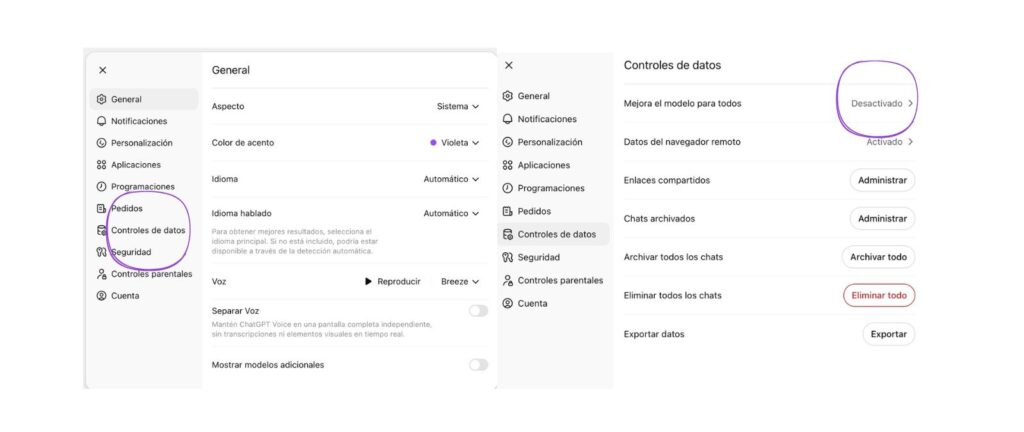

3. Controla el uso de tus datos para entrenamiento

Muchos chatbots permiten desactivar que tus conversaciones se usen para entrenar modelos, pero esta opción suele estar en la configuración y no siempre está activada por defecto.

4. No compartas información sensible

Evita ingresar datos que no confiarías a un extraño: nombres completos, dirección, documentos, información médica, financiera o confidencial de tu empresa, así como detalles íntimos de tu pareja.

5. Revisa los permisos

Verifica qué accesos tiene el chatbot en tu teléfono o navegador. En la mayoría de los casos no necesita ubicación, cámara o micrófono; lo ideal es conceder permisos solo cuando sea necesario.

El caso de Grok (xAI) y la privacidad

Grok es el chatbot de inteligencia artificial desarrollado por xAI, la empresa de Musk, disponible tanto en la plataforma X (ex Twitter) como en su propia app y sitio web. Desde su lanzamiento, ha protagonizado varios incidentes de privacidad.

Opt‑in automático de Grok

Por defecto, todos los usuarios de X quedan inscritos para que sus datos —publicaciones, interacciones y resultados con Grok— se usen para entrenar modelos de xAI, incluso si nunca usaron el chatbot. En Europa, xAI suspendió esta práctica por regulación, pero en otros países el opt-out sigue siendo responsabilidad del usuario.

Filtración masiva de chats en 2025

En agosto de 2025, unas 370,000 conversaciones privadas con Grok quedaron indexadas en buscadores debido a la función “Compartir”, exponiendo información sensible sin que los usuarios lo supieran. Luc Rocher, del Oxford Internet Institute, calificó a los chatbots de IA como “un desastre de privacidad en proceso”.

Cómo proteger tus datos en Grok o X

Desactiva la opción que permite usar tus datos para entrenamiento de modelos, borra el historial de conversaciones y haz tu cuenta privada. Aunque ya no uses X, tus publicaciones históricas podrían seguir siendo utilizadas.