Deepfake suplanta a exconductora uruguaya en falso noticiero sobre Ecuador

Lo que debes saber:

● Un video viral simula ser un reportaje del noticiero uruguayo «Subrayado» en el que se menciona al presidente Daniel Noboa y la instalación de bases militares extranjeras en Ecuador.

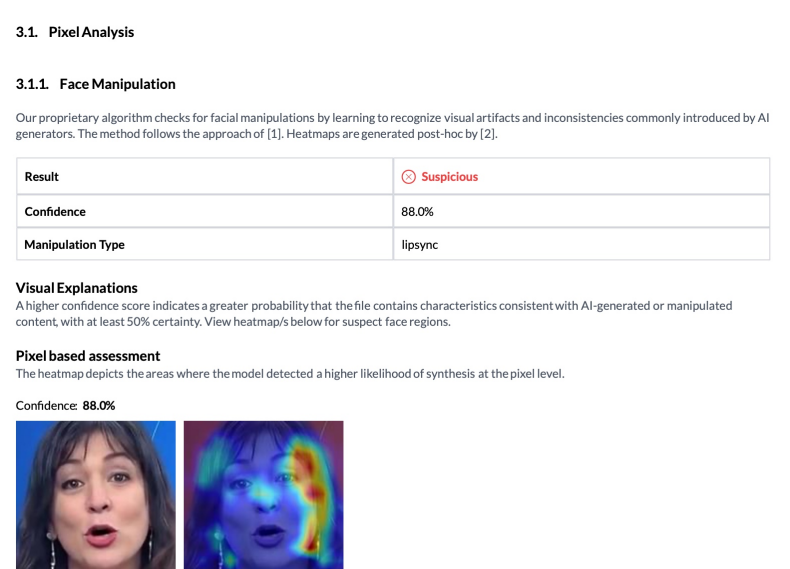

● El video fue creado con inteligencia artificial: Sensity AI detectó 88% de manipulación facial y 88.1% de alteración de voz en el contenido.

● El noticiero «Subrayado» no publicó este reportaje y las imágenes de la expresentadora fueron extraídas de un video de 2024 en el que anunciaba su retiro del medio.

Categoría

Metodología

¿Qué verificamos?

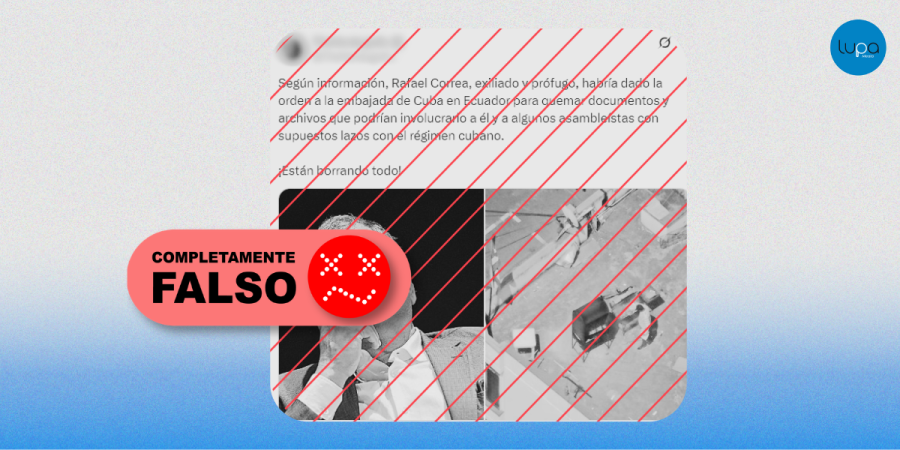

Un video que circula en TikTok y X desde el 25 de octubre de 2025 simula ser un reportaje del noticiero uruguayo Subrayado. En el contenido se menciona al presidente Daniel Noboa y a supuestas bases militares extranjeras en Ecuador, con la imagen de una presentadora del medio.

¿Por qué es completamente falso?

El video fue manipulado con inteligencia artificial para alterar la imagen y la voz de la presentadora Blanca Rodríguez. El noticiero «Subrayado» no emitió este reportaje. Las imágenes originales fueron tomadas de otros videos y modificadas digitalmente mediante técnicas de deepfake.

¿Qué dice la evidencia?

● Una búsqueda inversa con Google Lens identificó que el video manipulado circula en TikTok y X desde el 25 de octubre de 2025, con al menos 12 publicaciones que replican el mismo contenido.

● Sensity AI, detector especializado en deepfakes, identificó un 88% de manipulación facial y un 88.1% de alteración de voz, confirmando el uso de inteligencia artificial en el video.

● Lupa Media revisó los portales de Subrayado y Canal 10 con palabras clave como “Ecuador”, “Daniel Noboa” y “bases militares”: la última nota sobre Ecuador publicada fue del 7 de octubre de 2025, sin relación con el tema. Tampoco se halló el video en su canal de Youtube.

● En el video manipulado se observan movimientos de boca poco naturales y rasgos visuales alterados: piel excesivamente lisa, contorno facial alargado y contrastes irregulares. La voz tampoco coincide con la de la expresentadora.

● El clip original fue publicado el 5 de agosto de 2024, cuando Rodríguez anunció su retiro del noticiero.

● El logo del fondo también fue alterado: en el video falso aparece “Canal 10” en lugar del logotipo original del noticiero «Subrayado».

● Las imágenes del presidente Noboa fueron tomadas de su entrevista en CNN del 23 de octubre de 2025, donde mencionó que hubo una base militar estadounidense en Galápagos durante la Segunda Guerra Mundial.

Contexto importante

Ecuador se aproxima al Referéndum y Consulta Popular del 16 de noviembre de 2025, que incluye preguntas sobre la posible instalación de bases militares extranjeras, el financiamiento estatal a partidos políticos y la reducción del número de asambleístas.

Lupa Media evidenció en la anterior campaña electoral el uso sistemático de noticieros internacionales manipulados para difundir desinformación.

El proyecto Mercenarios Digitales (2023), del Centro Latinoamericano de Investigación Periodística (CLIP), documentó que la creación de falsos noticieros es una estrategia recurrente en la región, destinada a favorecer o atacar candidatos. En países como Ecuador, Guatemala y Venezuela, estos contenidos se difunden a través de cuentas falsas generadas con inteligencia artificial, que simulan credibilidad.

La inteligencia artificial generativa permite manipular imagen y voz de periodistas con gran realismo, replicando reportajes auténticos y alterando logos y gráficas de los medios.

Conclusión

COMPLETAMENTE FALSO: El video que simula ser un reportaje del noticiero uruguayo Subrayado sobre bases militares en Ecuador fue manipulado con inteligencia artificial. El medio no publicó este contenido y las imágenes de la expresentadora Blanca Rodríguez fueron alteradas digitalmente usando deepfake. La herramienta Sensity AI confirmó un 88% de manipulación facial y 88.1% de alteración de voz. Las imágenes del presidente Noboa fueron extraídas de una entrevista real en CNN del 23 de octubre de 2025.

Fuentes:

Usuarios Digitales

Búsqueda inversa de imágenes con Google Lens

Búsqueda en la página web de Subrayado

Búsqueda en la página web de Canal 10

Análisis con Sensity AI

Video original de Blanca Rodríguez anunciando su retiro (05/08/2024)

CNN – Entrevista a Daniel Noboa (23/10/2025)