Desinformación Electoral & IA: ¡Que No Te Engañen en la Consulta Popular!

1.-¿Qué es la desinformación con IA?

Es la creación y difusión de contenidos falsos o manipulados con herramientas de inteligencia artificial. Estas tecnologías permiten generar con gran rapidez:

- Imágenes o videos de hechos que nunca ocurrieron.

- Audios falsos, donde una voz clonada imita a políticos o figuras públicas.

- Videos hiperrealistas de personas que parecen reales, pero son totalmente sintéticas y se usan para simular entrevistas o noticieros.

2.- Identifica los deepfakes

Los deepfakes son audios o videos donde se suplanta a una persona para hacerla decir o hacer algo que nunca hizo.

Por ejemplo, durante la campaña presidencial de 2025 se detectaron deepfakes de periodistas, políticos e incluso artistas. No fueron casos aislados: formaron parte de estrategias coordinadas para desinformar, hacer propaganda, suplantar identidades y manipular percepciones.

@lupamedia 🔍 #FactCheckExprés | ❌ No, el Papa Francisco no se pronunció sobre las Elecciones Generales de Ecuador 2025. 🎥 El video que circula en redes con esas declaraciones fue manipulado con inteligencia artificial (IA). 📆 El material original fue publicado el 20 de diciembre de 2024 en el canal de YouTube Orbe 21. 🎙️ En la entrevista real, el Papa habla sobre la crisis global, las guerras, la Iglesia y la esperanza de la humanidad —no menciona temas políticos ecuatorianos. 🔗 Puedes ver el video completo aquí: https://youtu.be/xpBf-enOde4?si=5Jwye4kROzUkllGI #LupaTeExplica #Verificación #Desinformación #Elecciones2025 #Ecuador #IA #FakeNews ♬ sonido original – Lupa Media

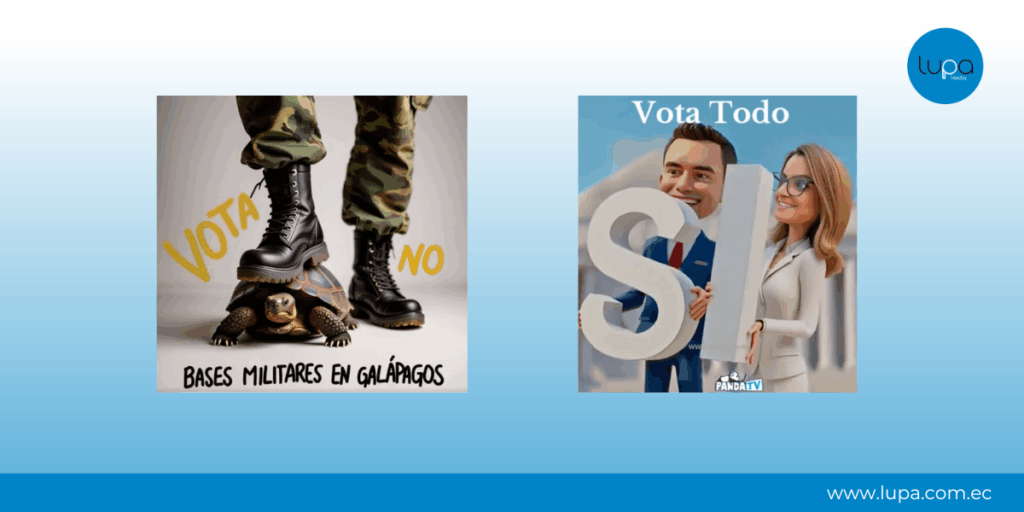

3.- Cuidado con las imágenes emocionales

No todas las falsedades alteran hechos concretos. Muchas imágenes generadas con IA apelan a las emociones, reforzando ideas o creencias previas para que el contenido parezca más convincente.

Un análisis de BBC Verify reveló que una foto creada con IA sobre una supuesta víctima de huracán en EE. UU. fue compartida por políticos porque “transmitía” el dolor de las víctimas, aunque era completamente falsa. Es decir, defendían una «verdad emocional», no un hecho.

4.- Detecta perfiles falsos y bots

Los perfiles falsos (que simulan ser personas reales) y los bots (cuentas automatizadas) amplifican la desinformación generada con IA. Buscan aparentar consenso o rechazo masivo a ciertas posturas de la consulta popular.

Señales de alerta: cuentas recién creadas, actividad excesiva o repetitiva, pocas interacciones reales, fotos genéricas o creadas por IA.

Evita interactuar con ellas y bloquéalas o repórtalas: así reduces su alcance.

5.- ¿Cómo afecta esto al proceso democrático

La IA puede usarse para:

- Distorsionar el sentido de las preguntas de la consulta.

- Atacar o desprestigiar a sus promotores.

- Difundir falsos anuncios oficiales sobre el proceso electoral.

- Manipular emociones con imágenes o videos falsos de disturbios o situaciones extremas.

Todo esto erosiona la confianza ciudadana y enturbia el debate democrático.

6.- Cómo protegerse

- Reporta contenido sospechoso en redes o ante el CNE.

- Verifica la fuente: busca medios confiables y cuentas oficiales.

- Desconfía de lo que te haga reaccionar fuerte (miedo, ira, entusiasmo).

- Usa herramientas de verificación: plataformas como Lupa Media ofrecen chequeos rápidos de videos, audios e imágenes.

- Contrasta información: consulta más de una fuente antes de creer o compartir.

Fuentes:

BBC – Verify

Lupa Media